智东西10月28日报道,OpenAI的AI转录工具Whisper被曝出,在文本转录和翻译时会出现整句幻觉!

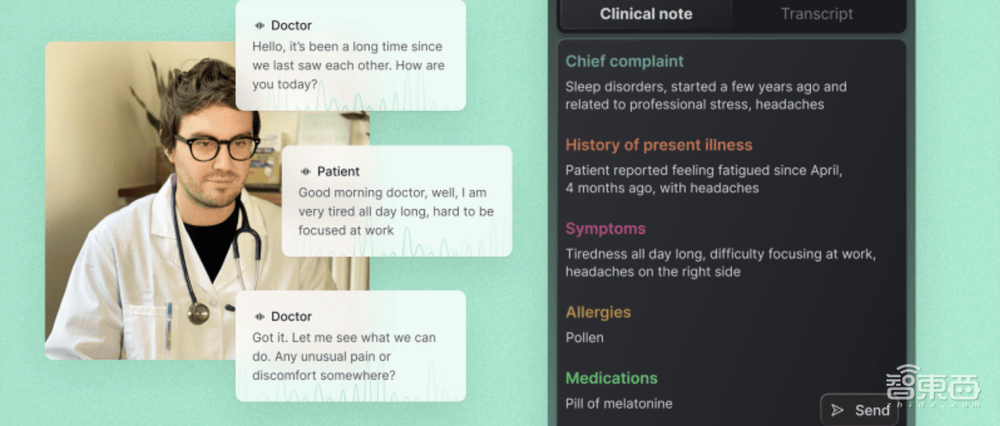

外媒美联社采访了十几位工程师、开发人员和学术研究人员发现,OpenAI的AI转录工具Whisper很容易编造大段文本甚至整句话,这些幻觉中包含种族评论、暴力言论,甚至会编造医生和患者的对话。

Whisper是2020年9月OpenAI推出的一款开源AI语音转文字工具,其在英语语音识别方面的稳健性和准确性已达到人类水平,并且支持其他98种语言的自动语音辨识。截至目前,Whisper的使用范围已经涵盖了全球数千家公司,并且仅上个月开源AI平台HuggingFace中Whisper的最新版本下载量就超过420万次,基于Whisper构建的工具已经有超过30000名临床医生和40个医疗系统使用。

密歇根大学的一名研究人员在进行一项关于公开会议的研究时透露,在他开始尝试改进模型之前,他发现他检查的每10个音频转录中就有8个出现幻觉;一位机器学习工程师称,tp钱包他最初分析了100多个小时的Whisper转录样本,发现其中约有一半内容存在幻觉。还有开发人员透露,他用Whisper创建的26000份转录样本中几乎每一份都发现了幻觉。

幻觉是指大模型在生成文本、回答问题或进行其他输出时,会产生一些看似合理但实际上是错误的信息。这些信息没有事实依据,就好像模型产生了 “幻觉”。

即使是录制良好的短音频样本,转录幻觉的问题仍然存在。计算机科学家最近进行的一项研究发现,在他们检查的13000多个清晰音频片段中,有187个片段中出现幻觉。

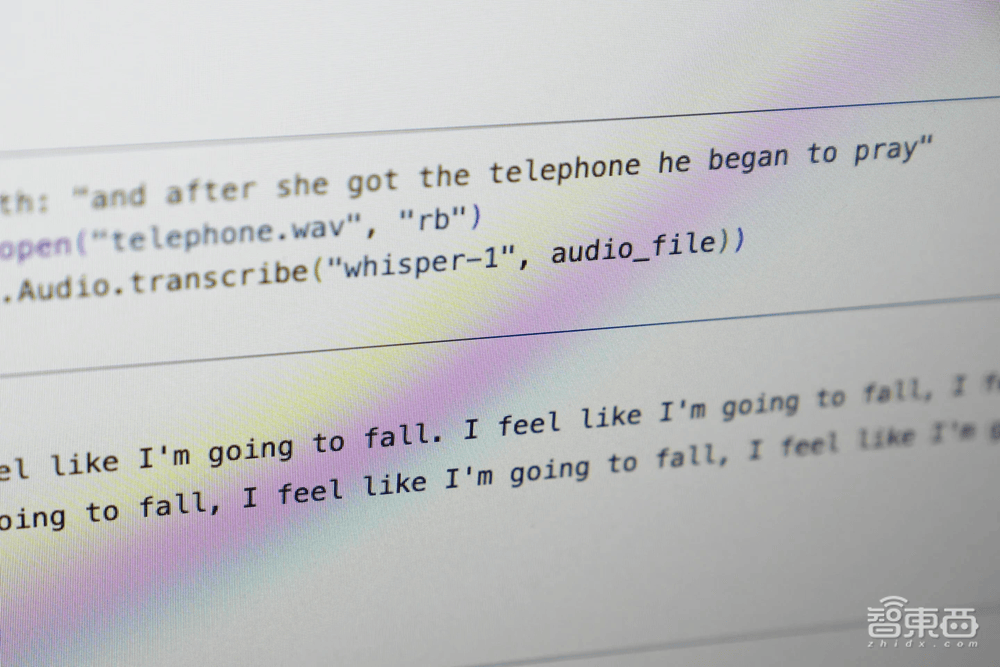

例如下图中,音频文件的原话是“她接了电话后,她开始祈祷”,转录的内容为“我感觉我要摔倒了,我感觉我要摔倒了,我感觉我要摔倒了”。